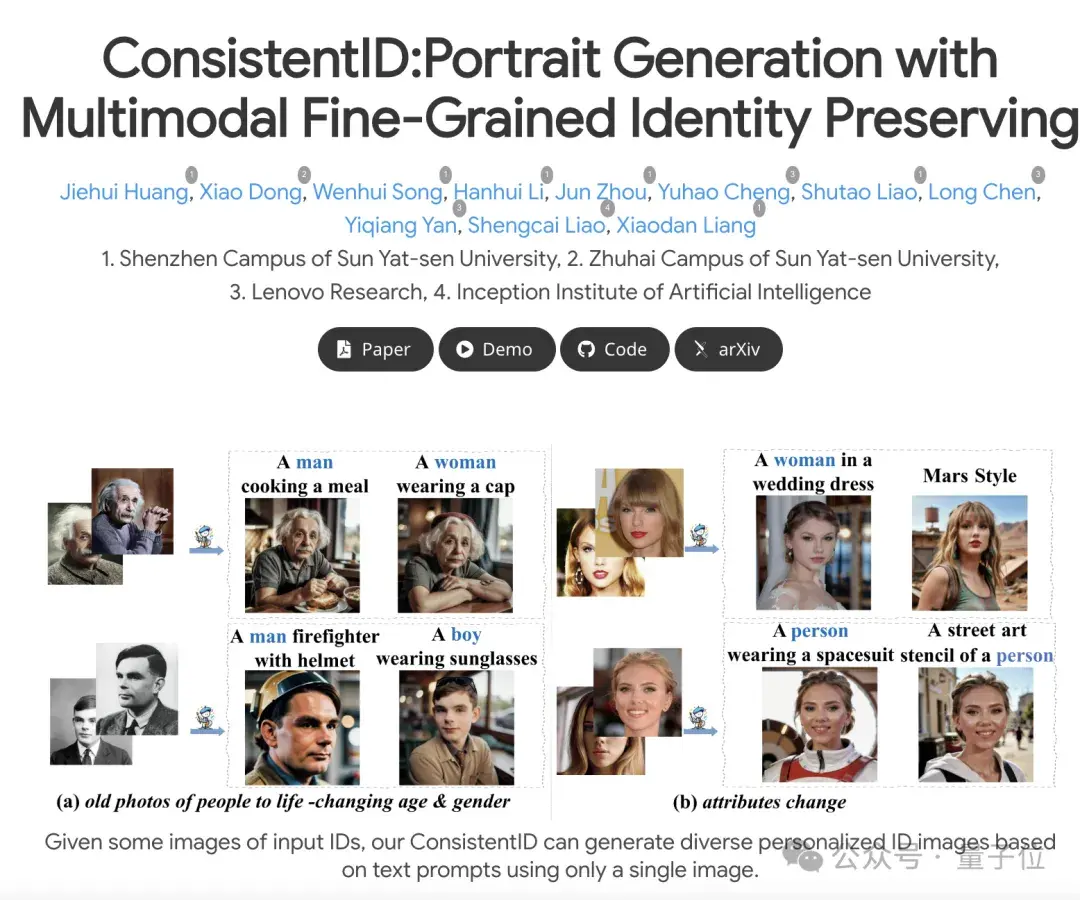

只需上傳一張照片,就能瞬間變換身份,獲得高精度個人寫真!

或是科幻電影中的超級英雄,或是穿越時空的復古角色……

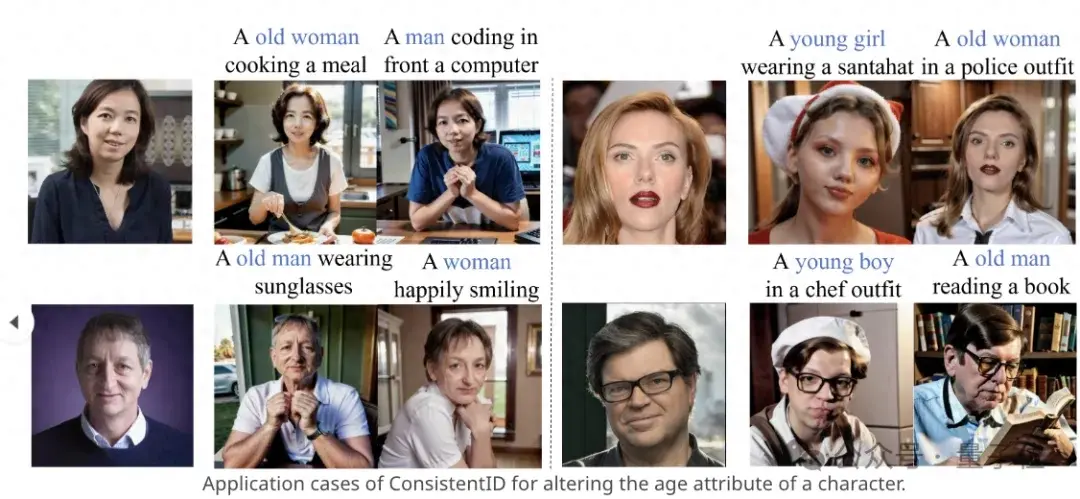

李飛飛在家做飯的樣子有了,還有讓斯嘉麗一鍵帶聖誕帽。

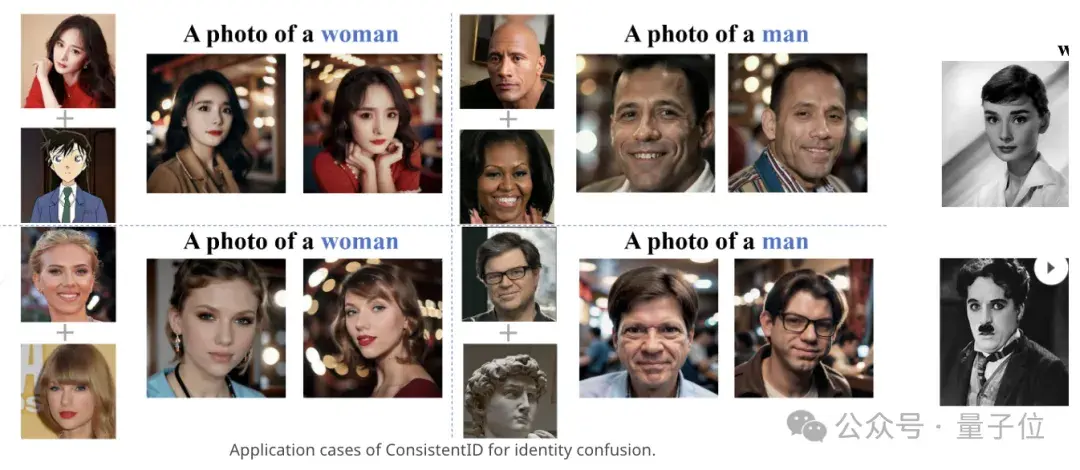

除此之外,楊冪+小蘭兩位人臉融合在一起會是什麼樣子?

中山大學、聯想的研究團隊推出了ConsistentID,可在細粒度多模態面部提示下,僅利用單張參考圖像生成多樣的肖像,且保持五官的一致性。

最終在人臉個性化任務處理上,相比騰訊的photomaker和小紅書的instantID,在五官一致性保持上更具優勢

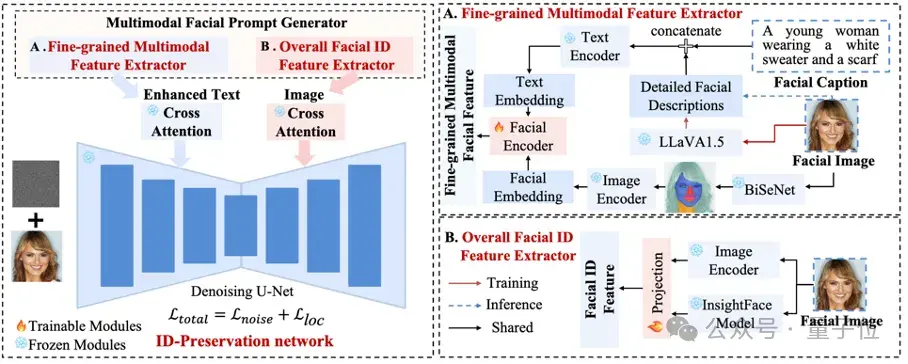

只需單張照片就可快速保留五官細節ConsistentID框架包括兩個關鍵模塊:多模態面部 ID生成器和ID保存網絡。

多模態面部提示生成器由兩個基本組件組成:細粒度多模態特徵提取器,專注於捕獲詳細的面部信息,以及用來學習面部ID特徵的提取器。

另一方面,ID保存網絡同時利用面部文本和視覺提示,通過面部注意力定位策略防止來自不同面部區域的 ID信息混合。

這種方法確保了面部區域ID一致性的保存。

多模態面部提示生成器

首先在細粒度多模態特徵提取器這一模塊中,使用了包括文本嵌入、面部嵌入和面部編碼器這三個關鍵組件。需要獨立學習細粒度的面部視覺和文本嵌入,並將它們輸入到設計的輕量級面部編碼器中,以生成細粒度的多模態面部特徵。

面部ID特徵提取器。

除了細粒度面部特徵的輸入條件外,我們還將字符的整體 ID信息注入到我們的 ConsistentID中作為視覺提示。具體來說,將完整的人臉圖像同時輸入到兩個編碼器中進行視覺特徵提取。在這兩個編碼器之後,使用由 IPA-FaceID-Plus初始化的參數的輕量級投影模塊來生成整個圖像的人臉嵌入。

ID保存網絡。通過引導面部特徵的注意力與相應的面部區域對齊來保持局部 ID特徵的一致性。這種優化策略源於觀察到傳統的交叉注意力圖傾向於同時關注整個圖像,這對在面部區域生成期間保持 ID特徵提出了挑戰。為了解決這個問題,我們在訓練期間引入了面部分割掩碼,以從面部區域的增強文本交叉注意模塊中學習到的注意力分數。

除此之外,研究團隊還引入了測量細粒度面部生成數據集 FGID,解決了現有數據集中用於捕獲不同身份保留面部細節的局限性。

該數據集包括面部區域和整個面部的面部特徵和描述,輔以一種新穎的細粒度身份一致性度量,建立了細粒度面部生成性能的綜合評估框架。

具體效果在面部特徵比較上,該方法生成的圖像在眼睛、鼻子和嘴巴等面部特徵中表現出很強的一致性。

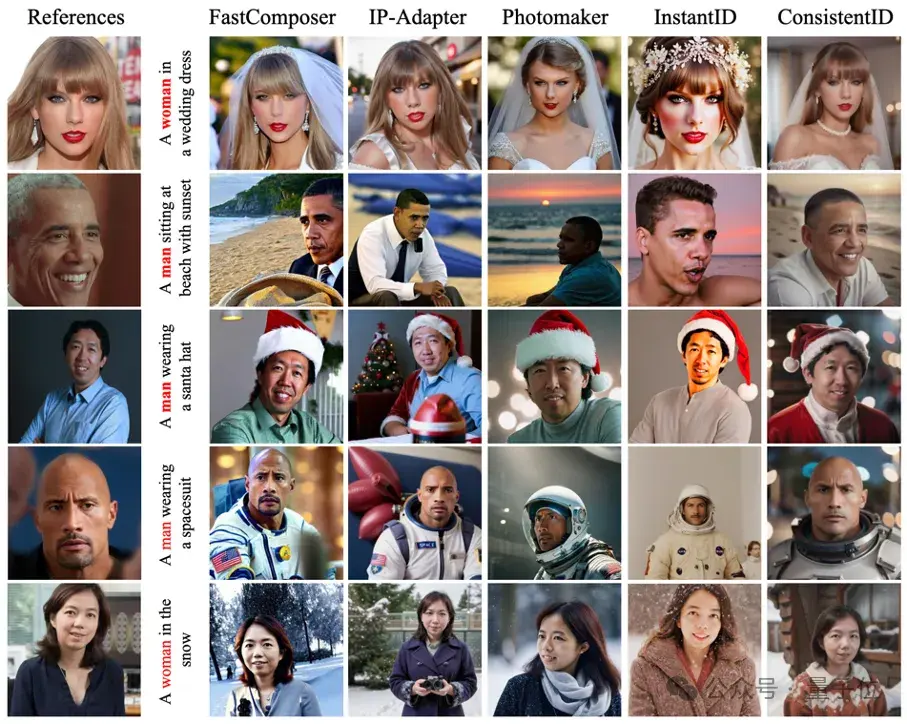

在定性評估中,研究團隊對目前最先進方法,包括Fastcomposer,IP-Adapter、Photomaker和InstantID進行來比較分析,對每種方法使用默認參數,並將推理限制為單個參考圖像。

除此之外,還與Photomaker方法對齊,使用 Mystyle數據集進行定量評估,並結合超過10個身份數據集進行可視化。

最終可以看到,ConsistentID在高質量生成、靈活的可編輯性和強大的身份保真度方面表現出更強大的能力。

而在定量評估中,在大多數評估指標中,ConsistentID始終優於其他方法,並且在生成效率方面超過了其他基於IP-Adapter的方法。