中國人的下一代,會因它而提前過時麼?

聊聊最近很火的ChatGPT的事兒。

這兩天,美國人開發的「會聊天的機械人」ChatGPT非常火爆,很多人驚嘆於這款人工智能的「能侃」——給它個題目,它能很快回給你一篇小作文,且語言風格、敘述邏輯都不像之前的AI那樣生硬了,粗略一聊,好像真的是一個人寫的。

甚至還有人逗悶子,讓ChatGPT模仿一些大V寫稿。

比如要求ChatGPT在論述某命題作文時,每段前面都加上「老胡覺得」「老胡還覺得」。

很多人試過以後說,基本看不出它和正主寫的有啥區別……

於是也有朋友跑我這兒來打趣,說:「小西,你擔不擔心ChatGPT再發展發展,把你飯碗也給搶了啊?」

對這種問題,我一般都回答「我不擔心,但我很擔心一些更要命的事。」

下面我就單開一篇文章,談談這個問題:

1

其實說起人工智能,我大學剛畢業那會兒曾經是這項技術的狂信徒,信仰到工作了很多年我都沒學車——因為那會兒自動駕駛被炒的很火,我經常幻想,再過上幾年,這項技術再來個重大突破。駕駛座就被智能AI接管了,那我費勁巴力的考駕照還有啥用?我又不擅長這個。

可是後來有次跟相關專業的一位朋友聊天,他一句話就改變了我的想法。

我那位朋友是這麼說的:「小西,車還是要學啊,可預見的未來,AI永遠不可能代替人類把方向盤——因為「電車難題」無法解決。」

我一聽這話就醒悟了,乖乖的去把駕照給考了——雖然前後掛了六次才過。

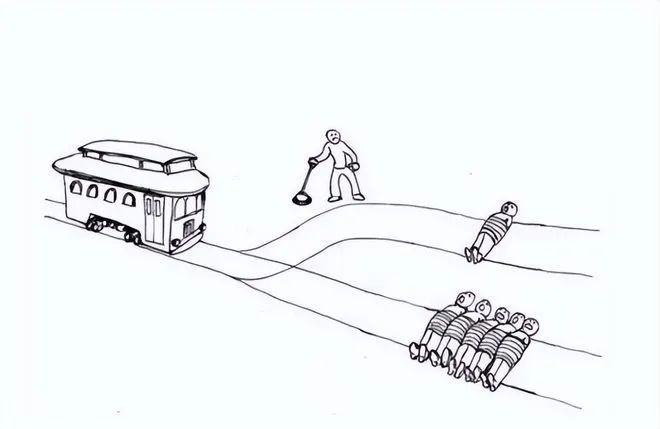

電車難題是什麼呢?給沒聽過的朋友再解釋兩句。

這個問題最早是由英國當代哲學家菲利帕.福特在討論墮胎問題時首先提出的。它的經典表述是這樣的:

說一輛電車在軌道上行駛,在它前面的軌道上被綁着五個人,可是電車剛好失控了,停不下來,眼看就要把這五個人給碾死。

這時,你剛好站在電車軌道的操縱杆旁邊。只要你拉下操縱杆,列車就會切換到備用軌道上去。可是,備用軌道上也有人被綁着,不過只有一個人。

那麼問題來了:這個操縱杆,你是拉還是不拉呢?

電車難題問世以來,引發很多倫理學和法理學的討論。功利主義和自由主義在拉不拉操縱杆這個問題上爭的面紅耳赤,但這個問題我們全切放在一邊,有機會再聊。這裏只說一個爭到最後各方都認的共識——那就是,人是要為自己的選擇負責的。

在現實當中,如果有一個人面臨類似的兩難抉擇——比如「你媽和你媳婦掉水裏,你救誰?」無論他最終的選擇是什麼,他人或者他自己的良心一定會不自覺的追問:我為什麼當時要這麼選?他必須說出一個所以然來。才能說服自己過去這個坎。

所以從這角度講,人要為自己的選擇負責,也只有人才可以為自己的選擇負責。很多高階的判斷問題,如果涉及到倫理、道德、審美,無法被自動化的原因,就是它其實怎麼選都對,怎麼選也都錯,只有當人類面臨那個場景,自己做這個判斷時,屬於他的、能夠讓他安心的「正確答案」才會被揭曉。

明晰了這一點,我們再去看自動駕駛這種人工智能代替人類的難點。就會發現它就卡在這裏——在駕駛這個場景中,很多時候是會面臨類似的電車難題的。比如,很多交通事故發生在車輛高速行使過程當中,前方突然出現人或者動物橫穿馬路。在這種情況下,很多司機會下意識的打方向盤,而結果有時會是車輛失速側翻,他要躲避的那個人沒事,但開車者和他的親友車毀人亡。

那麼好了,假如人工智能發展到可以完全替代人類進行汽車駕駛,需要為這種場景進行判斷。請問這個判斷程序怎麼寫?

人工智能也許可以通過模擬運算,算出作出規避動作後,馬路上的行人倖存概率增加,而司機的倖存概率驟減。而如果直接撞過去,行人八成就沒命了,但司機可以倖存。但人工智能真的可以代替駕駛者做「直接開過去」這種選擇麼?這個選擇是要承擔日後的法律、道德追問的。

如果允許人工智能代做判斷,拋開它將違反機械人不得傷害人類的「阿西莫夫定律」不談,它也相當於讓駕駛者逃離了這個必做選擇的場景。最終這類事件會產生一種「無人負責」的荒誕悖論。

這種悖論,甚至哪怕讓駕駛者在事先預設好自己的偏好判斷也無法規避。

比如一個人可以預先設想自己在高速行使中即便看到他人橫穿馬路也會為了自己保命而直接衝過去,可是事關臨頭,如果那個人是孕婦、老人、孩子,或者是他的家人、愛人,他的選擇也許就不一樣了。

很多事情,不事關臨頭,人類就是不知道自己的選擇會是什麼。這就是人性。

人工智能永遠無法複製人性的根本原因,不在於它能否深度模仿人類的思維,而在於它不能代替人進行這種判斷。

由此我們想到《聖經》裏那個故事——亞當和夏娃,因為偷吃禁果而受了神的厭棄與恐懼,被趕出了伊甸園,成為了真正的人。

但這個「禁果」是什麼呢?《聖經》的原文當中管它叫「知善惡果」,但有些翻譯當中,也會將其稱為「智慧果」。

其實你仔細想想,這兩個意思是想通的——人類思維中最核心的東西,是什麼?不就是知善惡、明是非、做判斷麼?當人有能力作出一個「怎麼選都對,怎麼選都錯」的價值判斷,並為這個判斷負責時,他才是個人。

而就像《聖經》中的上帝不想讓人具有這種自主意識一樣,人類一定會避免人工智能擁有這個能力,否則就真的要上演《我,機械人》了。

於是我們得到結論,那些要做價值判斷的工作,人類永遠無法放手讓機械人代勞。

開車如此,寫文章就更如是了。

2

實不相瞞,為了寫這篇稿子,我還真的專門去跟ChatGPT聊了聊,聊的過程中我也在反思——作為一個碼字者,我寫一篇文章,它對讀者價值究竟在哪裏?這些價值有可能被ChatGPT這種AI代替麼?

反思後我發現,一篇文章,至少有三層價值。

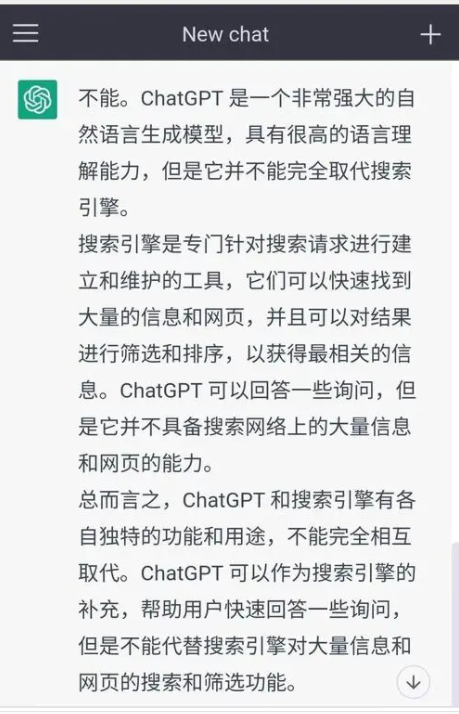

第一是「知識價值」,也就是談一件事,我要告訴你這件事是怎麼回事、相關有什麼數據、史料,把這些東西打包匯總給讀者,給讀者以開拓視野的作用。

這一層的價值,ChatGPT確實已經可以部分做到了,聊天過程當中你問它一個什麼什麼事,它能這件事的前因後果很準確、客觀且較有條理提供給你,這種能力甚至已經超越了人類寫作者。

但我之所以說,即便提供知識價值,ChatGPT也只能部分做到,是因為我發現它尚沒有的「深度聯想」能力——談一件事,它就只能給你就事論事的說這件事,像這篇文章那樣,從人工智能聊到電車難題、再想到《聖經》,這種開腦洞的創新性聯想,它是不具備的。

於是你就會發現一個問題——跟這傢伙聊天不「有趣」,人類思維的有趣,其實是建立在對多種知識的「通感」之上的。

「綠楊煙外曉寒輕,紅杏枝頭春意鬧。」「桃花潭水深深千尺,不及汪倫送我情。」「春意」和「鬧」之間,友情和水深之間,本來是沒有邏輯聯繫的,但人類的思維就是能通過這種合理的「大腦短路」將其構建聯繫。我總認為這就是思維樂趣。

而這樣的知識放飛自我又合情合理的鋪展、蔓延,我在ChatGPT寫的文章中是看不到的,AI能否通過深度學習或算法演進達成這種「通感」式的聯想,我對此持保留態度。

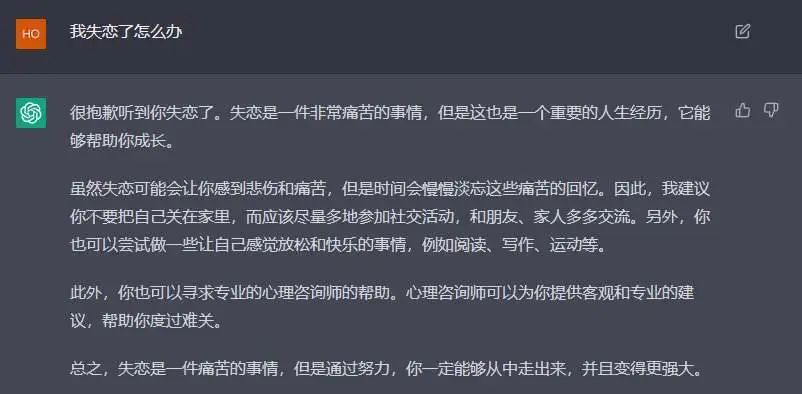

第二是「情緒價值」,讀我文章常了的朋友會知道,我寫文章是喜歡做情緒表達的,評論事情並非單純的平鋪直敘,有些事讓我開心,有些事引我調侃,有些事激我憤怒,有些事令我沉思。嬉笑怒罵之於文章,恰似酸甜苦辣之於菜餚。光有知識沒有情緒的文章,如同只有營養沒有味道的菜,至少我是不喜歡讀的。

而情緒這個東西,目前的人工智能還很難模仿,即便能進行模仿,跟ChatGPT這種機械人聊天,那種感覺也有點像跟矽膠娃娃談戀愛——她可能各方面都能滿足你的需求,但歸根結底,你會覺得味道是不對的,因為你知道對面那個東西,是個沒有生命的死物,它的情緒只是用一堆機械或計算架構模擬出來的。在新奇感消失之後,就什麼都沒有了。

談到這裏,我們不得不解析一個問題:情緒這種東西的本質是什麼?

在我看來,它其實也是一種人類才能作出的取捨和判斷。

因為與知識的聯想與通感需要跨界調動不同的知識體系剛好相反,情緒的產生與共鳴,其實恰恰來源於我們選擇性的關閉一部分認知甚至常識。

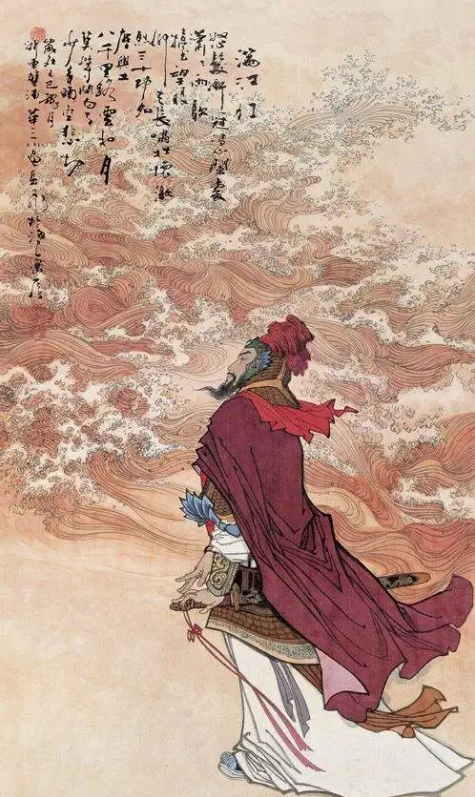

比如憤怒,《滿江紅》的名句「壯士飢餐胡虜肉,笑談渴飲匈奴血。」讀來讓人很提氣。但如果你真的較真,吃人肉、喝人血這種事情是很踐踏常識、甚至恐怖的事情,這麼寫和儒家痛斥的「率獸食人」的區別究竟在哪裏呢?作者為什麼在這裏可以屏蔽這部分常識,卻依然讓人共情呢?

這就說明人類在作出「憤怒」這個簡單動作的背後,做了非常複雜的倫理取捨與判斷,我們選擇性的關閉了一些認知。於是憤怒的情緒才能表達出來,並激發人共情。

同樣認知屏蔽,在「戲謔」、「悲傷」、「快樂」當中也會發生,AI無法自主模仿和使用這些情緒,與它無法處理「電車難題」一樣,也是因為它無法主動選擇在什麼時候關閉什麼認知。

它只能在你讓它講笑話時講個笑話、讓它表現憤怒時憤怒,讓它唱首讚歌的時候唱讚歌。

於是我們就討論到了文章價值中最重要的第三層:「判斷價值」。

是的,對於一篇文章,判斷是有價值的,而且是最高的價值。在跟ChatGPT聊天的時候,你會發現一個有趣的現象:一旦你問它如何評價一些敏感的歷史人物,或者怎樣評價「少數族裔」「同性戀」「墮胎」等問題時,該AI立刻丟棄原本盡力模仿人類聊天的那種風格,告訴你的本AI只是聊天工具,無法對該類爭議問題作出評述。

在我看來,ChatGPT這樣說,並不是開發者為了明哲保身,故意不談敏感話題。而是因為這類話題談到最後,往往都涉及「電車難題」式的取捨與判斷,所以無法交給AI去做。

比如談到墮胎,你是尊重母親的選擇權還是嬰兒的生命權?談到英雄,你是讚賞他對歷史車輪的推動,還是看重那些被車輪碾碎的個體?談到經濟模式,面對同樣的經濟困局和數據,你是贊同凱恩斯還是哈耶克?……

凡此種種,想說出個所以然,你必須首先把一些「電車難題」式判斷做了。而這一點,恰恰是AI沒有辦法進行的,如前所述,除非AI真的像伊甸園的亞當與夏娃一樣獲得了知善惡、行判斷的能力,否則它永遠無法寫這樣的文章。而如果AI達成這一點,就意味着它獲得了自主意識。那我們的問題,可就不是司機或作家會不會被砸飯碗這麼簡單了。

綜上所述:

在知識層面,AI暫時不具備將不同體系知識進行通感和創新式的能力。

在情緒層面,AI很難模仿人類準確把握在什麼時機關閉何種認知以達成哪種情緒。

而在判斷層面,在我們需要操心的未來,AI因為不能具有人格,無法進行複雜的價值判斷。

AI寫作註定只能寫這三種東西都沒有的文章。ChatGPT的寫作能力,其實已經接近觸及這類文章的天花板了。

所以,就像我對坐在汽車後座上看人工智能替我開車已經斷念一樣,我同樣永遠不擔心AI會砸我的寫作飯碗——本質上講,我和它從事的壓根不是一個行當。

3

但是,雖然我並不擔心ChatGPT會砸我的飯碗,但在和它聊過之後,我卻覺得另一種我們很仰賴的東西,很可能會隨着人工智能這場變革而過時、落伍——那就是我們的文化曾引以為傲的教育方式,和這種教育方式下流水線般生產出來的人才。

你小時候有沒有過這樣的經歷?逢年過節,親戚朋友聚在一起誇耀自己的孩子,興致所至,會把孩子叫到跟前,讓他給叔叔阿姨表演一個節目。而節目一般總是這樣幾類:識字或朗誦個唐詩宋詞,算數或者背個九九乘法表和圓周率,彈鋼琴、拉小提琴、吹個長笛黑管。

這樣的表演和孩子們之間的競賽,我小時候都經歷過,而且還算是這類「雞娃內卷」中的佼佼者。但你回頭仔細想想,我們的父母願意為之自豪的這些「特長」,其實都是高度「技術性」的:你能背下多少詩詞、能進行多麼精妙準確的數字運算、以及對樂器的肌肉記憶準確到了什麼程度,能不能把樂曲彈奏的「就跟電視裏放的一樣」……

而推而廣之的說,當我們走進學校,所經歷的整個教育訓練以及與之配套的選拔標準,也是這種技術性的,於是這就讓我們的學生一度看起來非常牛逼,大則奧賽拿獎,小也能當個「做題家」,把高考的分數弄得高高的。

但現在的問題是,在技術的日新月異下,這一類技能人已經越來越干不過機器了——

唐詩宋詞、圓周率你記得再熟,趕得上手機百度一下靠譜麼?

四則運算,甚至徒手開平方你算的再快,趕得上掏出計算機直接算一下快麼?

甚至你拎把琴到大街上去拉一曲,如果無法融入自己的情感和演藝,你拼的過帕爾曼、呂思清、帕格尼尼麼?

所以過度注重技術性技能的培訓,其實是一種前資訊時代、甚至前工業時代的培訓方式,在物資和信息都很匱乏的農耕社會,人們不得不靠死記硬背去記憶一些典籍,去徒手進行一些運算。可是到了資訊時代,尤其是人工智能發展起來後,這些「體力勞動式的腦力勞動」,都正在迅速被取代和淘汰。

所以我們的很多教育,很可能是在讓孩子苦練和比拼一些已經過時的東西。

明年春節,你讓自家孩子在親戚面前表演個鑽木取火吧。其實這和你讓他背圓周率啥的是一樣的——反正你耍的再花哨,將來都一樣是用不上。

那麼真正資訊時代的教育應該是怎樣的,我有一位同學,在美國一路讀到博士。有一次我跟他聊天,他說他剛去時最毀三觀的事情,就是老美太「傻x」,理科考試居然讓帶計算器進場,碰上個小學乘法,咱拿九九乘法表口算,他們在那兒啪啪摁計算器。文科老師也很拉胯,上課跟學生海聊到一個知識點,具體數字咬不准,毫不避諱的去辦公室翻本書來現查。

我問,那你覺得他們好的地方在哪兒?他想了想說,美國頂級大學的討論課比我們做的好。老師和學生讀完書把觀點放在一起碰,能聊出一些很不錯的真東西來。不像咱很多學校,就是讓學生輪流上去插優盤做個Presentation(報告)就交差了。

我曾經也沒覺得這是個什麼大問題,直到我後來在媒體工作,帶實習生,有一次改他的稿子。

今天想來,他的文章寫的就是那種「ChatGPT風格」——數據很準確、資料很詳實、但通篇讀下來,就是那麼一種一點味道都沒有的感覺——「聽君一席話,如聽一席話」。

我當時就說:

「你……這文章寫的挺用心的,就是……能不能再加一點好玩的東西進去?」

他很不解的問我:

「西老師,什麼叫「好玩的東西」?」

我當時自己沒想明白,沒法回答,試了試,還是就讓他那文章那麼過了。

但我想,今天這篇文章,我總算把這事兒捋清楚了:

在知識層面,就是那種「通感」式的新奇有趣的聯想能力。

在情緒層面,就是那種蘊含其中、引而不發的「文氣」。

在判斷層面,就是那種未必一定正確、但能夠給讀者以啟發或暢快感的見解。

這些東西,是AI無法模仿的,而只有人肉碼字的人才能寫出來。

它是我們吃這碗飯的人的看家本領,也是你能用於躲避AI砸飯碗的一招鮮,也很可能是國外一些高等學府注重培養的,但卻恰恰是我們的教育所不重視的。

我們的教育中摸爬滾打出來的好學生、做題家,大多可以非常優質的完成數據資料匯總這種「技術性」的工作——但這個工作,現在人工智能也能做了,而且能比你做的更快更好。

我不是搞工科技術的,所以我不知道我們工業上「創新力不足」的問題是不是也和這有關係。這裏就不贅述了。

總而言之,人工智能突飛猛進,對腦力勞動者們來說,其實不是一次毀滅一切「末日天劫」,而更像是一場「洪水」——當洪水襲來的時候,住在低地上的人們遭了殃,而處在高地上的人們卻可以安然無恙。

現在我們看到的局勢,就是洪水正在襲來,而發達國家正在通過它們的教育將其精英人才「搬到高處」。

而我們所要擔憂的問題其實是,我們文化過去過於注重的那種對「技術性」技能的培養和選拔,讓我們的太多人才都成了「低地上的人」,洪水沒有到來的時候,我們和人家一樣過日子,甚至可以依靠人口眾多和勤勞的精耕細作比他們做的更好。

可是,萬一人工智能的洪水襲來,將低地淹沒、高地留存,局勢很可能會發生驟然的變化。

這是一場基於技術革命的「水淹七軍」。

文章的結尾,再講一個故事吧。

這幅畫是描繪的是第二次鴉片戰爭當中的八里橋戰役的,

該戰當中,僧格林沁王爺率領「大清最後的鐵騎」蒙古騎兵以三倍於敵的兵力對英法聯軍發動了主動突擊,最終以屍橫遍野、精銳盡喪的代價,換得了法軍死3人、英軍死2人的戰果。

作為晚清最後的嫡系精銳,僧格林沁的蒙古騎兵作戰不可謂不英勇,訓練不可謂不有素。但問題是,他們苦練的那些技藝,什麼弓馬嫻熟、鐙里藏身,都是舊時代的技藝,當開花彈、連發槍、套筒刺刀等等等等革命性技術接連發生的時候,這些技藝很迅速的就被淘汰為了無用之技。

高度熟練這種技藝的個體是可悲的,因為他們終難有用武之地。而執着於這種訓練和選拔,無法扭轉的社會實體則更可悲,因為科技革命對他們並不公平,一種新技術的演進對別人來說只是換個活法,而對他們卻可能真的是滅頂之災。

但願,我們執着的不是新的「鐙里藏身」,但願我們不會再迎面撞上一輪技術突變引發的快槍齊射。