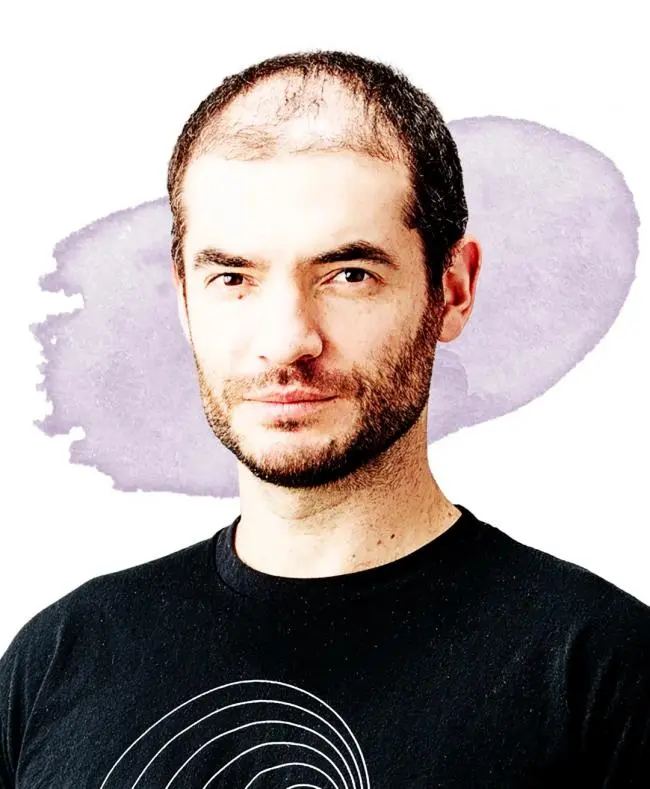

2023年,美國人工智能公司OpenAI的首席科學家、人工智能先驅伊利亞·蘇茨克維(Ilya Sutskever)入選《自然》年度十大人物(Nature's10),而非該公司行政總裁山姆·奧特曼(Sam Altman)。

超越人類智商的人工智能,還能掌握在我們手中嗎?

「人工智能會解決人類遇到的所有問題,也將帶來新問題。假新聞會嚴重一百萬倍,網絡攻擊會變得更極端,甚至是人工智能武器。」

2023年12月,OpenAI的首席科學家伊利亞·蘇茨克維(Ilya Sutskever)給爆火的ChatGPT澆了一盆冷水後消失了。

作為OpenAI公司負責融資和商業化的行政總裁,山姆·奧特曼(Sam Altman)一直被視為「ChatGPT之父」。

但幾乎沒人知道,在工程實現上為ChatGPT誕生做出突破的伊利亞,沒有他就不會有今天的ChatGPT。

年少成名

1986年,伊利亞出生在前蘇聯西部的下諾夫哥羅德,他在這裏生活了五年,蘇聯解體後全家搬去了耶路撒冷。

他經常建議OpenAI的員工閱讀《古拉格群島》,這是一本將近700頁,關於蘇聯強制勞動體系的非虛構作品。

動盪的生活直到他23歲那年才結束,全家離開以色列搬去了加拿大,伊利亞得以在多倫多大學完成學業。

2003年,剛上本科的伊利亞敲響了「人工智能之父」傑弗里·辛頓(Geoffrey Hinton)的辦公室大門,憑藉獨特的思考贏得辛頓的青睞。

當時正值人工智能寒冬,沒人相信辛頓的深度學習(Deep Learning)實驗——即通過訓練一個神經網絡來解決一個問題。

2012年,ImageNet大賽讓他們迎來了轉機,辛頓帶着他的兩位學生,其中之一就是伊利亞,在這次大賽中發明了AlexNet系統。

使用深度神經網絡,讓圖像識別率突破了75%的準確度,遠超所有競爭對手。由他們三人共同撰寫的論文至今引用量已超過6萬次,成為計算機科學領域引用最多的論文之一。

自此,深度學習廣為人知,當時伊利亞只有26歲。

改變AI進程

大賽結束後,伊利亞年少成名,三人共同創辦了一家名為DNNResearch的公司。

該公司並沒有推出任何產品,也沒有明確的發展計劃。包括百度、谷歌、微軟在內的四家公司參與了競標收購。

2013年3月,谷歌以4400萬美元的金額收購了該公司,並聘請伊利亞擔任Google Brain的研究科學家。

圖像識別並非是伊利亞的研究巔峰。

2016年,谷歌一款圍棋人工智能程序AlphaGo(又稱「阿爾法狗」)擊敗了韓國國手李世石。在與李世石交手的第二場比賽中,第37手棋超越了所有人類棋手的理解範圍,最終指向了勝利。

「想像一下,如果這種洞察力可以使用到各種地方,會怎麼樣?」伊利亞參與了AlphaGo研發的核心工作。

除此之外,他還發明了一種將英語翻譯成法語的變體神經網絡——序列到序列學習(Sequence-to-Sequence Learning)算法。

當時的研究者們並不相信神經網絡能夠進行翻譯工作,而伊利亞的發明擊敗了表現最佳的翻譯器,促使谷歌翻譯重大升級,讓機器翻譯領域從此煥然一新。

在人工智能的關鍵發展節點中,伊利亞沒有缺席任何一個章節。就在所有人以為谷歌能繼續輝煌時,伊利亞卻轉身離開了。

與ChatGPT決裂

2015年,帕洛阿爾托一場小型晚宴上,奧特曼與馬斯克決定創辦一個非營利性的AI研究實驗室,他們將其命名為OpenAI。

這次晚宴上,OpenAI首次明確提出創始理念——「利用人工智能造福全人類,並以負責任的方式推動人工智能的發展」。

伊利亞和馬斯克、奧特曼坐在同一張餐桌上,馬斯克不惜和谷歌DeepMind的行政總裁哈薩比斯決裂,也要把伊利亞從谷歌挖出來,擔任OpenAI的首席科學家。

此時的伊利亞對OpenAI的未來充滿期待。

伊利亞沒有辜負OpenAI,他幾乎主導並推動了之後的一切。伊利亞主導了對GPT的研發,後來發展成了GPT-2、GPT-3和ChatGPT。

但從ChatGPT開始,伊利亞與奧特曼在OpenAI路線選擇上的裂縫就已經出現了。

《大西洋月刊》採訪了OpenAI的10名現任和前任員工,還原了一個事實:ChatGPT在2022年11月的上線,是一個帶有些防禦性意味的倉促決定。

ChatGPT激增的流量帶來了巨大安全風險——比如將ChatGPT用於行騙。包括伊利亞在內的安全和和對齊團隊希望ChatGPT的進展能夠放慢一點,ChatGPT的商業化也與最初的使命背道而馳。

2023年11月,OpenAI將山姆·奧特曼踢出局,伊利亞代表董事會通知了關於其被罷免的決定。

在一些零碎的報道里,伊利亞跟他的同事提起,把奧特曼踢出局是OpenAI能夠沿着正確道路做AI研究的「唯一路徑」。

超級對齊

伊利亞對AI和人類的不信任感與他的導師辛頓十分相似。

ChatGPT問世後,辛頓提出了一個看起來非常致命的問題,「我並不知道之前有任何案例,關於低智能物種能夠對高智能物種實現完全的掌控」。

他擔心AI會在海量數據中學習到意想不到的行為時,最終威脅到人類——比如欺騙,偽造的圖片,和漫天的假消息。

為此伊利亞提出了「超級對齊」的概念——

其含義是確保當未來人類對人工智能系統的評估把握超過了那個可控的臨界點後,人類仍然有可以有效地監督人工智能系統的辦法。

通俗點說,確保AI永遠受到人的控制。

但對馬斯克和奧特曼等一眾矽谷精英而言,當人們掌握一個顛覆性的產品或者技術,最好的辦法是儘快把它拿到眾人面前,哪怕這個產品或技術還不完美,真實的反饋比在象牙塔里夯實基礎更有價值。

山姆·奧特曼與伊利亞·蘇茨克維。

在奧特曼離開後,OpenAI內部迎來了史無前例的混亂局面,科研出身的伊利亞顯然無法控制。但也是伊利亞,最後選擇在要求董事會讓奧特曼復職的請願書上簽了名。

無論如何,伊利亞參與或主導的工作一度改變了計算機視覺領域、機器翻譯甚至自然語言處理領域的研究進程,其研究工作被引用超過42.7萬次,成為引用量最多的計算機科學家之一。

美國《時代》雜誌稱其「真真切切,就是那個有能力決定人類未來的人」。一個人工智能是否會統治人類的電車難題,站在這個關鍵節點上,或許沒有人能不猶豫。