AI詐騙正在爆發,

據邁克菲安全技術公司最新報告,受到AI詐騙,77%的人會遭受經濟損失。

詐騙者通過被害人的社交媒體、上網記錄,採集其各方面的生活信息和行動軌跡,合成對方的聲音、人臉,詐騙其朋友、親人、同事,讓人防不勝防。

▲

去年,AI在詐騙案頻發,「9秒被騙245萬,10分鐘被騙430萬」等詐騙案件多次登上熱搜

據安徽警方通報,去年4月,有人換臉成被害人的好友,稱有一個項目招標需要周轉資金,視頻通話僅9秒鐘,就詐騙到245萬。

去年10月,有博主發文稱,有人通過AI換臉,製作她的裸照進行敲詐。

如何識別AI詐騙,碰到後應該怎麼辦?我們和AI詐騙的親歷者、AI工程師聊了聊。

自述:安安,20歲,大學生

我目前正在讀大二。有一天我在QQ上收到了一個好朋友發來的消息。她問我在幹嘛,寒暄了幾句,就說她的微信被限制了,想轉錢到我的銀行卡號,讓我幫她買個東西。

涉及到錢,我就比較謹慎了,我說我們先視頻一下。她也沒猶豫,打開了視頻。長相、聲音和我朋友一摸一樣,我們視頻了5秒鐘就掛了。確認了臉,我就放鬆了警惕。

▲

安安和對方的聊天截圖

我問她想買什麼,她沒回復,直接讓我發銀行卡號過去,她轉錢給我。我沒有多想,把卡號發給她了。她給我發了個充值Q幣的連結,讓我點連結幫她買3500元的Q幣。

我當時也挺奇怪的,無緣無故為什麼要買Q幣?我問她是不是在做暑假工,但她跳過了我的問題,說已經把錢轉過來了,問我收到沒有。我並沒有收到。她開始兜圈子,說再去問問客服,確認一下,讓我先幫她買一下,錢一會兒就能到賬。

如果我大意一些,錢也就轉過去了,但我再次起了疑心,就讓她再接一次視頻電話。這時候她也有些不耐煩,說,就是我本人你放心。

我怎麼放心呢?我們平常基本都在微信聯繫,她怎麼突然QQ聯繫我?況且是買虛擬貨幣,發過來的也是陌生連結。我就去微信跟我這位朋友確認,她說根本沒有在QQ上找我。

說實話我當時都快被嚇哭了,又去QQ問對方,讓她打開視頻給我看,打開後還是我朋友的樣子。她為了讓我放心,甚至拿出了身份證給我看,根本看不出來臉是AI合成的。掛了電話,我罵了騙子幾句,她看我遲遲不轉賬,好像也識破了,就沒有繼續裝了。

後來我朋友才發現她的QQ賬號被盜了。至於身份證,她覺得可能是之前在某個網站上上傳過身份證照片。但是想來想去,我們也不知道到底是哪個環節出了問題。如果不是去微信多問了一句,我差點就被騙了。

自述:Mike,23歲,留學生

我今年23歲,目前在美國讀書。說實話,第一次碰到AI詐騙的時候我真的一身冷汗。

去年聖誕節我和同學去南美玩,那陣子和我爸媽聯絡也比較少。有一天半夜我突然接到我媽的微信電話,接上的時候發現她已經打了3、4個了。我當時也嚇一跳,以為家裏發生什麼事。她當時帶着哭腔,問我怎麼樣,還好嗎。我當時也有點懵。

▲

編造「留學生被綁架」,是詐騙犯常用的手段

她告訴我,她白天接到我的電話,來電顯示是我國內的手機號,電話那頭也是我的聲音,我說自己在南美洲被綁架了,跟我媽要10萬美元贖金,否則就活不了了,沒說幾句電話就掛了。

我媽當時差點就信了,她嘗試給我的手機打電話,發現打不通,當時隔着太平洋,她也沒辦法確認真假,只感覺聲音是我的,她甚至報了警,警察告訴她再通過別的途徑確認一下,因為當時是夜裏,我的微信也連續打不通。

她有點兒着急了,後來我爸給我打手機電話,我媽嘗試給我打微信電話,兩個人折騰了半天,幸好我的手機平常不會關聲音,最後我還是接到了。

我安慰她我沒事,就是在旅遊。她當時都將信將疑的,問我剛才我的聲音是怎麼回事。我當時根本不知道還有AI詐騙這回事,也是嚇得夠嗆。

後來我們打開了視頻,她看到我真的沒事,才放心下來。後來我上網去查,才知道有些AI詐騙不僅會黑你的手機通訊錄,還會黑進你的微信,除了聲音,連臉都是可以偽造的。

▲

電影《孤注一擲》劇照,主線故事圍繞電信詐騙展開

平常我和爸媽的聯繫頻率還是比較高的,基本上每周都要打兩三個電話,就是那次,我恰好在外面旅行,也發了自己旅行城市的定位,和家裏聯絡比較少了。

所以我後來想,可能就是因為這樣,詐騙犯利用了這個「空檔」,他們通過我的社交媒體知道了我的位置,也不知道怎麼黑到了我國內的號碼,提取了我的聲音,來詐騙我爸媽。還特意選擇了我晚上在睡覺,可能接不到電話的時間。

我是比較小心謹慎的性格,之前也比較保護自己的私隱,比如我在國內的時候,每次收到快遞一定會把自己的個人信息塗抹掉再扔快遞盒,也不輕易在外面留自己的電話號碼,上網記錄也會定時刪除,但是有時候難免會泄露一些信息,太難防了。

Q:AI詐騙主要指的是什麼?

A:AI詐騙主要採用的技術是Deep fake,意思就是深度偽造。它是一項人工智能的人體圖像合成技術。AI詐騙主要就是利用這項技術,進行換聲、換臉,再通過電話、社交媒體進行的欺詐。

▲

在《速度與激情7》拍攝過程中,保羅·沃克意外車禍去世,片方討論後,邀請保羅-沃克的兩個弟弟擔任替身,正臉則用AI技術複製保羅的臉

Q:正常情況下,這項技術運用於哪些領域?它的發展經歷了哪幾個階段?

A:早期,這項技術主要用於影視的後期剪輯,比如說最出名的《速度與激情》,保羅·沃克意外車禍去世後,片子的後半部分就是用了deep fake的換臉技術。

2018年,當時出現過一個政治的惡搞視頻,一個美國演員用Deep fake技術製作合成了一個視頻,奧巴馬大罵特朗普是個笨蛋,其實他本人從沒說過這種話。這個視頻在推特上獲得200多萬次的播放,影響力非常大。也就是因為這個虛假新聞,讓這個技術慢慢走進大眾視野。

後來在日本,這個技術也被用來造黃謠,有年輕人通過換臉技術,出售偽造的不雅影片。再後來,就開始出現電話語音詐騙,還有我們看到的更高級的換臉變身詐騙。其實一直到2022年,AI詐騙才開始集中大量出現。

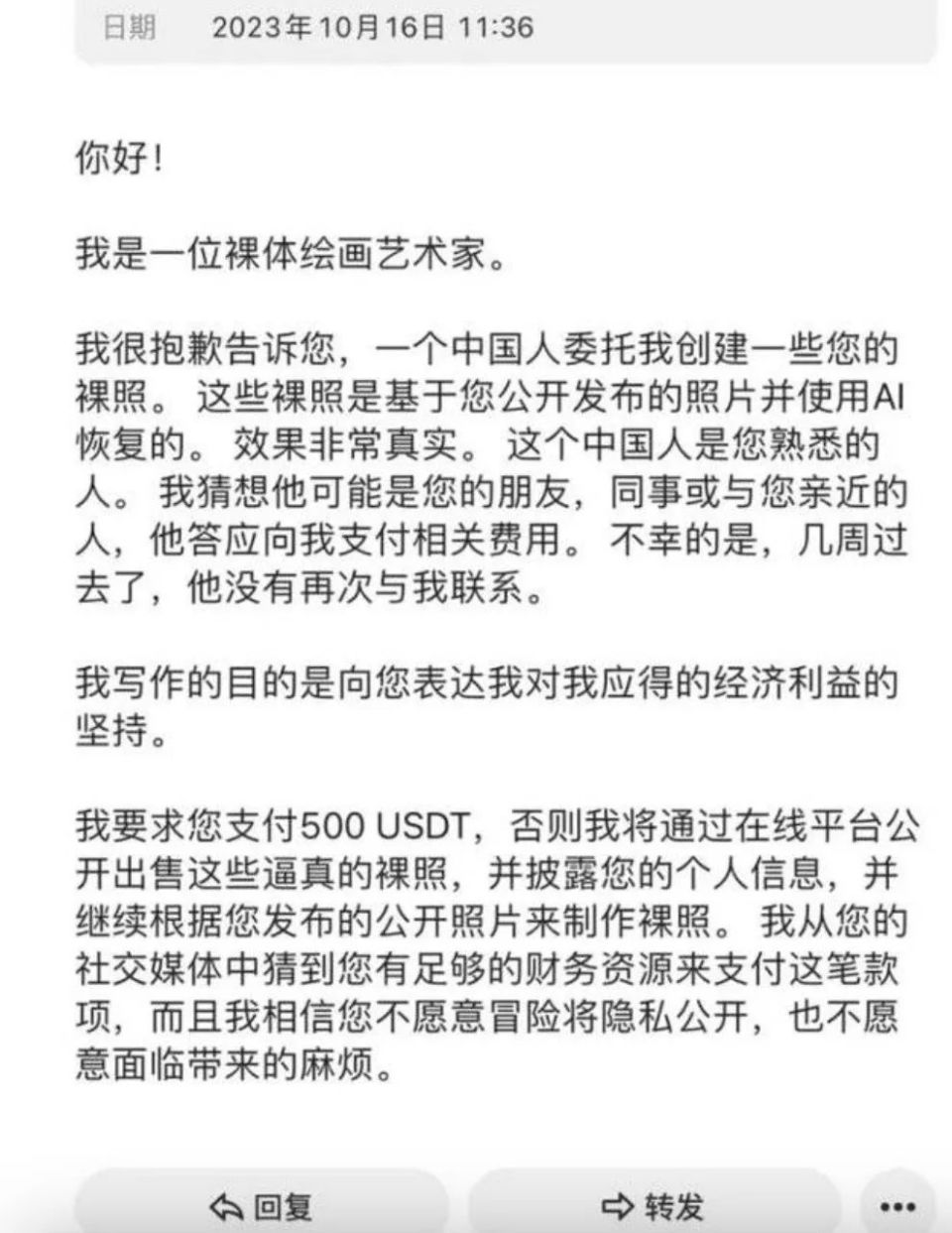

▲

去年10月,一位自稱裸體繪畫藝術家的人稱自己受到委託,按要求製作某博主的裸體圖片,因委託人沒有付費,所以他向博主索要500 USDT(加密貨幣,約合人民幣3500元),否則自己將會公開出售其裸照

Q:AI詐騙爆發有哪些原因?

A:在早期,硬件設施還不是非常完善,deep fake也有一定技術門檻,需要有一點代碼能力的人才會去使用。所以AI詐騙沒有那麼猖獗。2023年,被稱為「AI元年」,讓人驚嘆的chatgpt也出現了,可以說AI技術突飛猛進,加上這幾年計算機硬件革新,算力大幅提升,讓能使用deep fake的硬件比較容易獲得。

而且,這項技術是開源的,比較容易獲取。在專業的軟件網站、應用商店,甚至網購平台就能找到。任何人都可以下載、學習和使用。

而且經過不斷的優化整合,現在的技術壁壘越來越低。比如說在網上,有些人會出售「一鍵安裝包」,讓普通小白一鍵安裝後就能使用。甚至在某些渠道,你花幾塊錢就能找人幫做一條換臉視頻,所以主要是因為AI技術的學習、獲取門檻越來越低,導致AI詐騙的門檻也越來越低。

▲

圖片來源:petapixel

Q:AI詐騙常見的一些方式和手段包括哪些?

A:首先就是語音詐騙,比如通過一些唱歌、配音軟件提取你的聲音,通過騷擾電話來提取你的聲音,進行後期合成。還會通過盜號,用一些第三方的插件,實現語音轉發,獲取你的聲音樣本,再電話詐騙。

如果要更高階一些,他們還會通過遠程控制軟件,向指定的目標人發送含有惡意軟件的連結或者文件,一旦你打開,它就可能去控制你手機上的一些APP,甚至盜取你的賬號密碼、個人身份信息等等,獲取你的聲音和照片,再去了解你的生活,找到你熟悉的親人、朋友,直接打視頻過去,進行詐騙。

▲

徐欣正在科普AI數字人,使用deep fake技術改換人臉。來源:@超級頭腦AI魔法師

Q:AI詐騙為什麼難以識別?能通過具體案例講講嗎?

A:AI詐騙是一套「組合拳」。換臉變身,只是詐騙的最後一步。

第一步,犯罪分子會通過AI工具選取詐騙對象,一定是各方面條件都是他們可以把握的。我們在瀏覽網站的時候,會留下cookie。詐騙犯通過盜取QQ等社交媒體,對方可以推斷出你大概的年齡段、經濟水平。

通過公共的社交軟件,比如說小紅書、抖音等等,你可能發佈了一些個人信息,詐騙者也可以通過這些大致推斷出你的身份、對什麼感興趣。了解你的個人形象,你的生活圈、行動軌跡,才會為你量身定做一個「詐騙劇本」。

比如說之前新聞說一個人十分鐘被詐騙了430萬,假如說那是一個沒有做過功課的騙子,就只是換臉成他的一個普通的朋友,單純跟他去借錢,別說借430萬,幾萬塊可能都有困難。

因為騙子之前盜他的賬號,收集了他個人私隱的信息,了解到他最好的朋友是誰。這個朋友在什麼時候,剛好有一個項目,這個事是真實存在的。然後他就來冒充這個朋友打電話給被害人,說我這邊的項目可能需要借點錢。當時肯定有顧慮,但是兩個人打開視頻,看了視頻發現確實是朋友的臉,聲音也是,才上當受騙。

還有一個學生,他是剛好那段時間出國旅遊,沒開國際漫遊,詐騙犯就是盯准了他和父母電話溝通不是很順暢這段時間,冒充他去跟他父母要錢,說是在國外遇到了什麼事兒,讓他父母把錢打到一個賬戶。利用這種時間、時空差也是他們常用的手段。

工具在變,但是詐騙他最終騙的是人性,他會利用受害者一些恐懼心理,冒充領導、冒充公檢法之類的,利用受害者對權威機構天生的畏懼心理,通過偽基站,用官方號碼給你發送信息。

Q:我們應該如何防止私隱泄露?

A:首先我們瀏覽網頁的時候,儘量關閉cookie,及時清除瀏覽記錄,關閉「登錄網站自動保存密碼」的選項,不要在非官網的網站留下身份信息,電話信息。

在社交平台,儘量不要發清晰的正面照,發朋友圈關閉定位,不接騷擾電話。最重要的就是不點陌生連結,在手機上下載國家反詐APP。

Q:作為普通人,我們如何識別對方是否是AI詐騙?

A:在開視頻的情況下,我們可以有意識地引導對方做一些動作,比如說張大嘴巴,或者說大幅度搖頭,讓對方用手擋在臉前面等等。因為目前這個技術雖然可以換臉,但是它對於突然出現在攝像頭的阻礙物,是沒有辦法進行快速分辨的,這個時候,人的面部就會有變化,產生一些變形。

而且deep fake訓練模型的時候,大部分用的是人物正臉,對於側面甚至後腦勺是訓練不到的。它能夠訓練人物的五官,但是很難改變人的臉型、骨骼形狀。所以說對方做大幅度動作的時候,可以從側面,後面這些方位去看,就能看到一些瑕疵。

此外,偽造的人臉,他的眨眼頻率會比較低,對方的情緒也可能和當時的情景不符合,畫面會停頓,這時候先不要考慮是不是網不好,可以考慮有可能是偽造的。

如果對方打來的是語音電話,我們可以嘗試用方言交流。假如騙子已經高階到連方言都對答如流,那只有一個辦法,就是聊私隱,聊你們沒有從沒有同任何人講過,沒有在社交軟件上說過的事情。

還有一個辦法是,直接撥打對方的電話,但是注意不要通過通訊錄找對方的名字打,因為對方可能已經黑進了你的通訊錄,最好直接輸入對方的手機號打過去詢問,關鍵就是多個渠道驗證。核心就是,只要談到錢,無論對方是誰,都要謹慎。

Q:AI詐騙案件的偵破方面,有哪些難度?

A:最大的難度在於AI詐騙具有高隱蔽性,很難獲得線索。假如詐騙犯設置了一個虛擬IP,他就可以在全世界任何一個國家、任何一個地區來詐騙任何人。你可能在中國受騙了,你去報警,但是騙你的人是在大洋彼岸的其他國家,是任何一個人種。加上對方的聲音、形象都是合成的,就是難上加難了。但我還是建議被AI詐騙一定先報警,至少留下一份檔案。

Q:在電信詐騙、AI詐騙這方面,我們國家有相應的法律舉措嗎?還有哪些方面需要完善?

A:2023年1月份,我們國家頒佈了一條《互聯網信息服務深度合成管理規定》,規定了深度合成服務提供者的主體責任,就是從技術提供者的源頭去規範和管理。

當然,漏洞依然有,目前急需完善的地方就是技術層面。對於第三方軟件、Ai軟件,我們對它的攔截、識別技術,還是比較滯後的。

其實在國外,已經有相關的技術,比如美國一家科技公司,去年6月份他們就宣佈將增強AI反詐檢測技術,設計了一款軟件,可以立即發現偽造內容,能識別99.5%的deep fake的內容。

對我們來說,AI工具的使用範圍離普通民眾還是稍微有些遠,AI技術更多應用在大健康產業,天氣預測等等。其實我們普通人也可以提高AI技術的素養,多了解一些AI知識,它的底層邏輯,也是有助於我們識破詐騙的。

:全球騙局