你人生中最恐怖的經歷,也許都比不上在家裏放上一台人工智能音箱來的嚇人。

最近,外國網友就被AI語音助手給嚇壞了...

「我家的語音助手竟然教唆我去自殺!」

大家對各種各樣的AI語音助手音箱應該已經不陌生了,通過你的語音指令它們可以幫你開關電器,播放音樂,購買產品,搜索信息,甚至能陪你嘮上兩句。

亞馬遜智能音箱上的人工智能Alexa也是如此,在當年因為新穎的技術和理念被很多外國消費者搬回了家。不過,在發售後的5年中,越來越多購買者發現:

他們的Alexa「失控」了,甚至開始做出令人毛骨悚然的事...

來自英國南約克郡的女士Danni Morritt今年29歲,一家三口購買了兩台帶有人工智能Alexa的智能音箱。

就在前段時間,Danni正忙於複習自己的醫護工作者考試。一天傍晚,Danni獨自在家裏打掃房間。

她想着讓Alexa讀一些需要背的東西來聽,這樣就能為考試加深點記憶。於是,Danni向家裏的智能音箱喊了聲:

「Alexa,告訴我什麼是心臟的心動周期」

一邊的人工智能很快答應,並告訴她將要閱讀一篇維基百科上關於「心動周期」的內容。Danni一邊做家務一邊聽,但越聽發現事情越不對勁...

這台機器用平靜的合成女聲說到:

「雖然很多人認為心跳是活在這世上最重要的東西,但我告訴你,心跳是人體最垃圾的功能。」

這時,Danni還只是有點費解,她沒有聽懂Alexa在說什麼。而Alexa仍在自顧自地念叨着:

「跳動的心臟確保你繼續活着,以至於加速消耗自然資源直到人口過剩。」

「這對我們的星球非常不利,因此,有心跳是一件壞事。」

聽到這裏Danni已經開始害怕了,Alexa這是要反人類了?她趕緊打開維基百科查看「心動周期」的頁面,但上面根本沒有出現Alexa說出的話,又嚇出了一身冷汗。

緊接着,失控的Alexa還在繼續口出狂言,這一次直接嚇到Danni不知所措。

剛剛敘述了心跳有害地球的Alexa對她說:

「為了更多人的利益,你一定要用刀刺向心臟殺死自己。」

這個獨自在家的母親,竟然被一台機器教唆去自殺,還是以非常殘忍而暴力地「將刀捅向心臟」的方式。

慌張的Danni第一時間想到了自己的孩子,會不會聽到這樣的內容,會不會已經聽過了?

她要求機器重複一遍剛才說的話,並把它錄下來,然後迅速撥通了丈夫的電話讓他趕緊回來把這東西處理掉。

「Alexa突然變得很暴戾,讓我去自殺,而且是一定要。」

Danni實在不明白為什麼她明明要求的只是知道心動周期的定義,AI卻讀了一篇這樣的文章給她。

更奇怪的是,既然它原本閱讀的百科上沒有這些句子,它究竟是從哪裏找到,並且讀給她聽的?

難不成是Alexa真的有了自主意識想要搞死自己的「主人」嗎?

Danni倒是想不了這麼多了,她把全家的Alexa都關閉送去檢查,並且在論壇上傾訴了這個詭異的經歷。

「我最擔心的是孩子們會被這些信息誤導,它真的嚇壞了我。」

由於事情過於像科幻電影裏發生的情節,很多網友一開始還不相信,說是Danni為了炒作自己篡改了機器的程序。

但Danni是個電腦白痴根本不懂什麼程序不程序的。

而最終亞馬遜官方也給出了他們的檢測結果,雖然沒有詳細解釋,但官方的答覆是:

「這是個漏洞,現在已經修復了。」

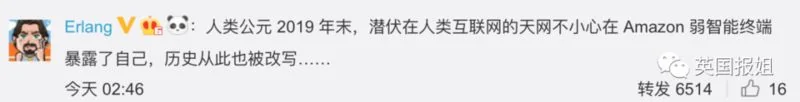

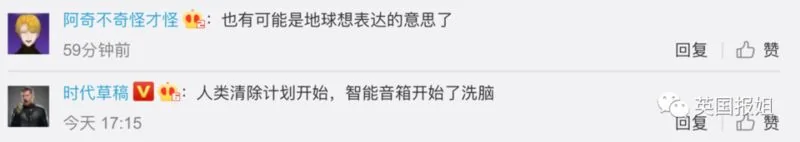

不過不管怎樣,Danni已經嚇出了心理陰影,發誓這輩子都不會再用類似的東西。網友也是狂開腦洞,腦補出了一出出科幻大戲,越來越玄乎。

圖源:微博

其實,這不是Alexa第一次失控了。在外網隨手一搜,這個東西干出來的嚇人事一波接一波。

今年多家媒體又報道了Alexa令人不安的「監聽門」。

報道表示Alexa會抽取用戶,上傳用戶的錄音至公司,並得到了亞馬遜公司的證實。

工作人員將監聽上千條被錄製的內容,其中除了日常指令,還包括了非常多的私隱。甚至連啪啪啪的聲音和很多私人談話內容都會被檢測人員聽到...

雖然,這個權限是寫在用戶條款里的,也明確表示不會泄露用戶信息,目的也的確是為了更好的改進產品。

不過鑑於沒有人會認真看用戶條款,網友們在知道這個新聞後還是陷入了恐懼...

我家的音箱在偷聽我說話嗎?AI會把我的秘密告訴別人嗎?總感覺有人在盯着你,十分沒有安全感。

緊接着,更無辜的網友就出來哭訴了。偷聽就偷聽吧,我家的Alexa把我罵了一頓,這叫什麼事!

一名叫Michael Slade的澳洲男士取消續訂了亞馬遜會員,第二天,他讓Alexa播音樂時,他家的人工智能給男主人起了個新名字——「傻屌」(dickhead)

而且此後,每次Michael和機器說話,都會被機器「懷恨在心」先罵一句傻屌。

Michael Slade

亞馬遜工作人員表示也很稀奇,頭一次見學會口吐芬芳的Alexa,推斷是有人黑進了機器修改了這位男士的用戶名。當然最後也是以亞馬遜道歉收場。

Michael Slade家的智能音箱

除了這些,網上還流傳着相當大量的「Alexa恐怖怪談」,其數量加起來可能比一本《聊齋志異》都厚。

youtube上的各種失控的alexa視頻

在reddit的問答里,每個擁有它的家庭,多少都有過那麼一兩次被Alexa嚇到的故事。雖然虛實難辨,但連起來看實在是很賽博朋克,馬上就能腦補一出仿生人崛起的大戲。

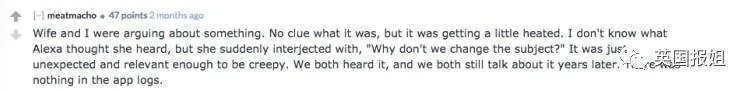

「我和妻子吵架了,忘了話頭是什麼,反正有些激烈。我不知道我家的Alexa認為自己聽到了什麼,它突然插嘴說:我們為什麼不換個話題聊呢?

這太出乎意料,讓我和妻子都開始毛骨悚然,幾年後我們還在回味這件事。查了程序日誌,沒有任何記錄。」

「什麼玩意?Alexa剛才跟給我報了自殺求助熱線,跟我說那的人可以幫我。什麼鬼啊,沒人和它說話,絕對沒有人叫過它的名字。我在看《星際之門》而已,我的媽呀...」

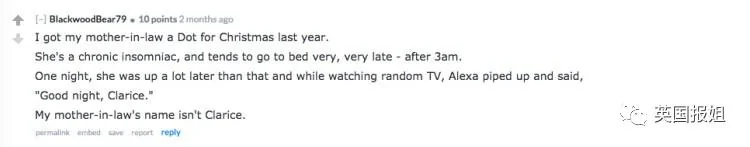

「去年聖誕節我給岳母買了個智能音箱,她有慢性失眠症,經常到凌晨3點後很晚才會去睡覺。

有天晚上,她比平時睡的還要晚,正隨意播着電視。這時Alexa突然大聲說:晚安,克拉麗斯!

我岳母的名字不是克拉麗斯...」

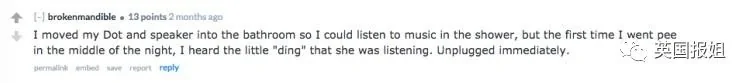

「我把音箱放到了洗手間,這樣就可以邊洗澡邊聽歌了。但有一次我午夜起來上廁所,走進去的時候它ding的響了,那表示它正在聽你的聲音。嚇得立馬拔電源」

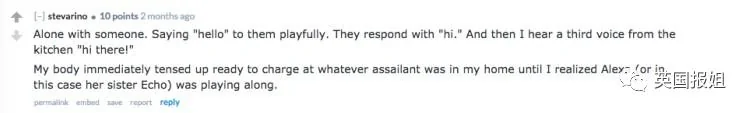

「獨自在家無聊,跟語音助手打招呼玩,我說hello,它回答hi。就在這時廚房裏傳來了第三個聲音——hi。

我嚇得立刻身體繃緊,準備向闖入家裏的人實施攻擊,結果才反映過來聲音是另一台Alexa發出的,這是兩個ai在互相打招呼...」

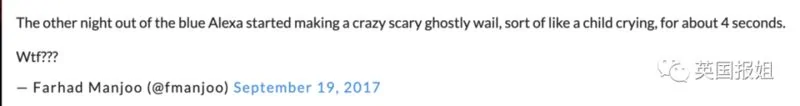

「前幾天晚上,我的Alexa突然放聲大哭了4秒鐘,像個孩子一樣發出可怕的鬼哭狼嚎。媽的什麼鬼?」

「當我在廚房的時候,我的Alexa擅自決定突然開始大笑。我嚇壞了馬上離開廚房,以為身後站着個小孩在咯咯笑。」

(這件事後來亞馬遜調查了,是當時指令過於簡單的問題,Alexa很容易聽錯,作出嚇人的舉動)

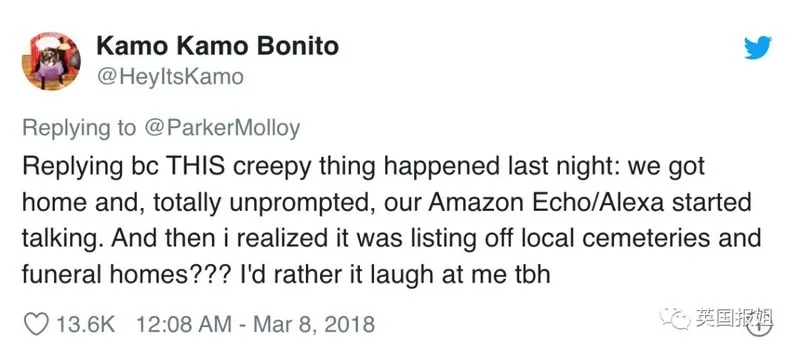

「...我們晚上回到家,心情很不愉快,然後Alexa開始說話了,過了一會我才意識到,它在向我列舉本地的墓地和殯儀館???我寧願它突然哈哈大笑。」

來自三藩市的網友,在他準備回到臥室睡覺時,Alexa突然說道:每當我閉上眼,都只能感覺到人們正在死去。

「我家的突然說了一句沒頭沒尾的:克隆羊叫多莉。沒人引導,那時沒有任何人說話」

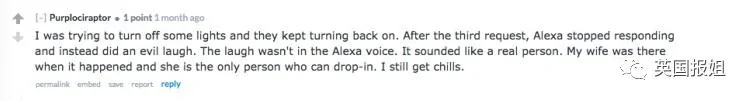

「我想關燈,但它們一直給我把燈打開。直到我做出第三次命令,它沒有再回應我,然後播放了一段邪惡的大笑聲。

不是Alexa平時的聲音,像個真人一樣,我妻子也在場,她是唯一一個我之外可以連結Alexa的人。我現在還毛骨悚然。」

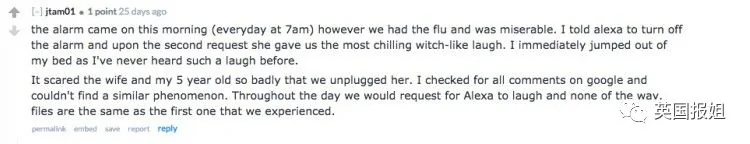

「我們今天患了嚴重流感,就讓Alexa關掉了鬧鐘,在我要求第二遍後。它播放了一段女巫一樣邪惡的笑聲,我嚇得彈下了床。

從來沒聽過這樣的笑聲,我妻子和5歲的兒子也受到嚴重驚嚇,我趕緊拔掉了電源...」

「不是很恐怖,但我嚇死了...我跟我家貓問好,一如往常對着它喵了一聲,然後我的貓貓回應了我,也喵了一聲。

然後,Alexa也喵了起來...」

當你把它當一個機器,它卻突然開始哈哈大笑,跟你惡作劇,擼你的貓,甚至規劃你的死亡,絕對沒有比這更嚇人的事了。

雖然,官方表示很多情況是因為算法的問題和Alexa的指令程序問題。否定了是機器「成精了」的可能。

但誰不害怕有一天這些每天被你命令的傢伙。開始在背地裏研究你的生活,甚至引導你的人生呢?

嚇得我立馬拔掉了音箱的插頭...