2023年8月3日,華爾街和矽谷聯袂奉上了一件震撼業界的大事:讓一家創業公司拿到23億美元的債務融資,抵押物則是當前全球最硬的通貨——H100顯卡。

這個大事件的主角叫做CoreWeave,主營業務是AI私有雲服務,簡單說就是通過搭建擁有大量GPU算力的數據中心,來給AI創業公司和大型商業客戶提供算力基礎設施。CoreWeave累計融資5.8億美金,目前是B輪,估值20億美元。

CoreWeave成立於2016年,創始人是三個華爾街大宗商品交易員。剛開始公司的主營業務只有一個:挖礦,採購大量GPU來組建礦機中心,尤其是在幣圈低潮時,公司會逆周期囤大量顯卡,也因此跟英偉達建立了鐵杆的革命友誼。

2019年,CoreWeave開始把這些礦機改造成企業級數據中心,向客戶提供AI雲服務,剛開始的生意也不溫不火,但ChatGPT誕生之後,大模型的訓練和推理每天都在消耗大量算力,已經擁有數萬張顯卡(當然未必是最新型號)的CoreWeave嗖的一下起飛,門口擠滿了客戶和風投。

但令人感到蹊蹺的是:CoreWeave累計一共只融到了5.8億美金,賬面GPU的淨值不會超過10億美元,甚至公司整體估值也只有20億美元,但為何卻能通過抵押借到23億美元呢?一向精於算計、熱衷對抵押物價值膝蓋斬的華爾街,為何如此慷慨呢?

原因極有可能是:CoreWeave雖然賬上還沒這麼多顯卡,但它拿到了英偉達的供貨承諾,尤其是H100。

CoreWeave跟英偉達的鐵杆關係已經是矽谷公開的秘密。

CoreWeave三位聯合創始人

這種鐵杆根源於CoreWeave對英偉達的毫無二心的忠誠和支持——只用英偉達的卡、堅決不自己造芯、顯卡賣不動時幫英偉達囤卡。

對黃仁勛來說,這種關係的含金量,遠超跟微軟、Google和特斯拉的那些塑料友情。

因此,儘管英偉達H100十分緊缺,英偉達還是把大量新卡分配給了CoreWeave,甚至不惜限制對亞馬遜和谷歌等大廠的供應。黃仁勛在電話會議里誇讚:「一批新的GPU雲服務提供商會崛起,其中最著名的是 CoreWeave,他們做得非常好。」

而在喜提23億美金的一周前,CoreWeave就已對外宣稱,將耗資16億美元在德州建立一個佔地面積42,000 平方米的數據中心。僅憑藉跟英偉達之間的關係和優先配貨權,CoreWeave就可以把建數據中心的錢從銀行里借出來——這種模式,讓人想起了拿地後立馬找銀行貸款的地產商。

所以可以這樣說:當下一份H100的供貨承諾,堪比房地產黃金時代的一紙土地批文。

一卡難求的H100

今年4月在接受採訪時,馬斯克抱怨道:「現在似乎連狗都在買GPU。」

很諷刺的是,特斯拉早在2021年就發佈了自研的D1晶片,由台積電代工,採用7nm工藝,號稱能替代當時英偉達主流的A100。但2年過去了,英偉達推出了更為強大的H100,而特斯拉的D1沒有後續疊代,因此當馬斯克試圖組建自家的人工智能公司時,還是得乖乖地跪在黃老爺門前求卡。

H100在去年9月20日正式推出,由台積電4N工藝代工。相較於前任A100,H100單卡在推理速度上提升3.5倍,在訓練速度上提升2.3倍;如果用伺服器集群運算的方式,訓練速度更是能提高到9倍,原本一個星期的工作量,現在只需要20個小時。

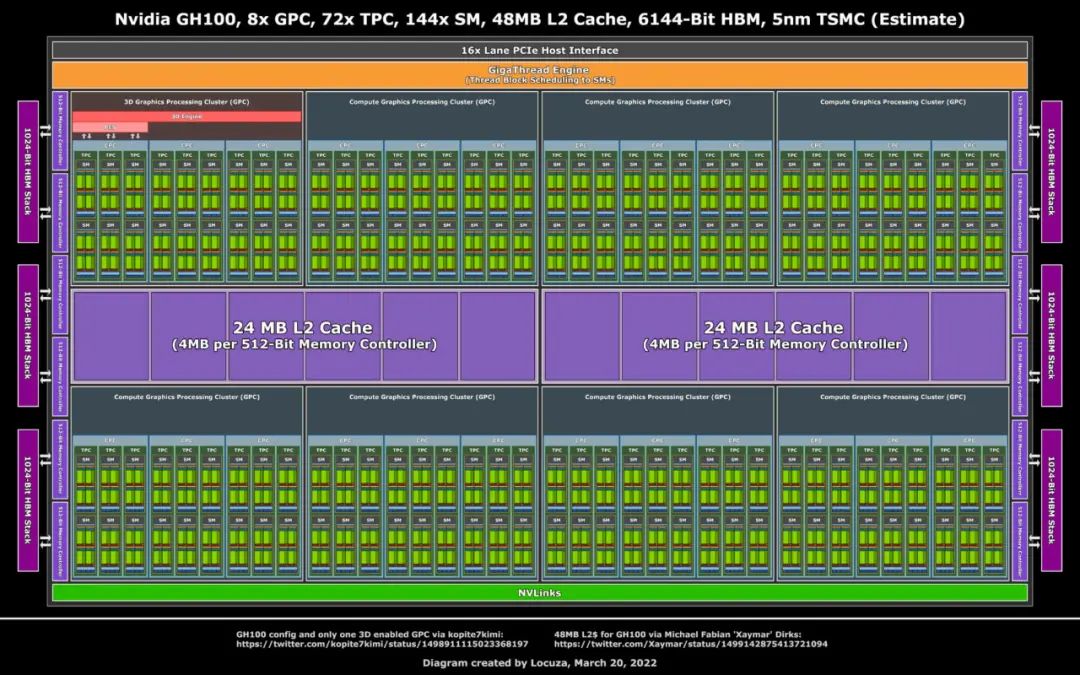

GH100 架構圖

相比A100,H100的單卡價格更貴,大約是A100的1.5~2倍左右,但訓練大模型的效率卻提升了200%,這樣這算下來的「單美元性能」更高。

如果搭配英偉達最新的高速連接系統方案,每美元的GPU性能可能要高出 4-5 倍,因此受到客戶瘋狂追捧。

搶購H100的客戶,主要分成三類:

第一類是綜合型雲計算巨頭,比如微軟Azure、谷歌GCP和亞馬遜AWS這樣的雲計算巨頭。他們的特點是財大氣粗,動輒就想「包圓」英偉達的產能,但每家也都藏着小心思,對英偉達的近壟斷地位感到不滿,暗地裏自己研發晶片來降低成本。

第二類是獨立的雲GPU服務商,典型公司如前文提到的CoreWeave,以及Lambda、RunPod等。這類公司算力規模相對較小,但能夠提供差異化的服務,而英偉達對這類公司也是大力扶持,甚至直接出錢投資了CoreWeave和Lambda,目的很明確:給那些私自造芯的巨頭們上眼藥。

第三類是自己在訓練LLM(大語言模型)的大小公司。

既包括Anthropic、Inflection、Midjourney這種初創公司,也有像蘋果、特斯拉、Meta這樣的科技巨頭。它們通常一邊使用外部雲服務商的算力,一邊自己採購GPU來自建爐灶——有錢的多買,沒錢的少買,主打一個豐儉由人。

在這三類客戶中,微軟Azure至少有5萬張H100,谷歌手上大概有3萬張,Oracle大概有2萬張左右,而特斯拉和亞馬遜手上也至少拿有1萬張左右,CoreWeave據稱有3.5萬張的額度承諾(實際到貨大概1萬)。其他的公司很少有超過1萬張的。

這三類客戶總共需要多少張H100呢?根據海外機構GPU Utils的預測,H100當前需求大概43.2萬張。

其中OpenAI需要5萬張來訓練GPT-5,Inflection需求2.2萬張,Meta則是2.5萬張(也有說法是10萬張),四大公有雲廠商每家都需要至少3萬張,私有雲行業則是10萬張,而其他的小模型廠商也有10萬張的需求。

英偉達2023年的H100出貨量大概在50萬張左右,目前台積電的產能仍在爬坡,到年底H100一卡難求的困境便會緩解。

但長期來看,H100的供需缺口會隨着AIGC的應用爆發而繼續水漲船高。根據金融時報的報道,2024年H100的出貨量將高達150萬張-200萬張,相比於今年的50萬張,提升3-4倍。

而華爾街的預測則更為激進:美國投行Piper Sandler認為明年英偉達在數據中心上的營收將超過600億美元(FY24Q2:103.2億美元),按這個數據倒推,A+H卡的出貨量接近300萬張。

還有更誇張的估計。某H100伺服器最大的代工廠(市佔率70%-80%),從今年6月開始就陸續出貨了H100的伺服器,7月份產能陸續爬坡。一份最近的調研顯示,這家代工廠認為2024年A+H卡的出貨量會在450萬張~500萬張之間。

這對英偉達意味着「潑天的富貴」,因為H100的暴利程度,是其他行業人難以想像的。

比黃金更貴的顯卡

為了搞清H100有多暴利,我們不妨把它的物料成本(Bill of Materials, BOM)徹底拆解出來。

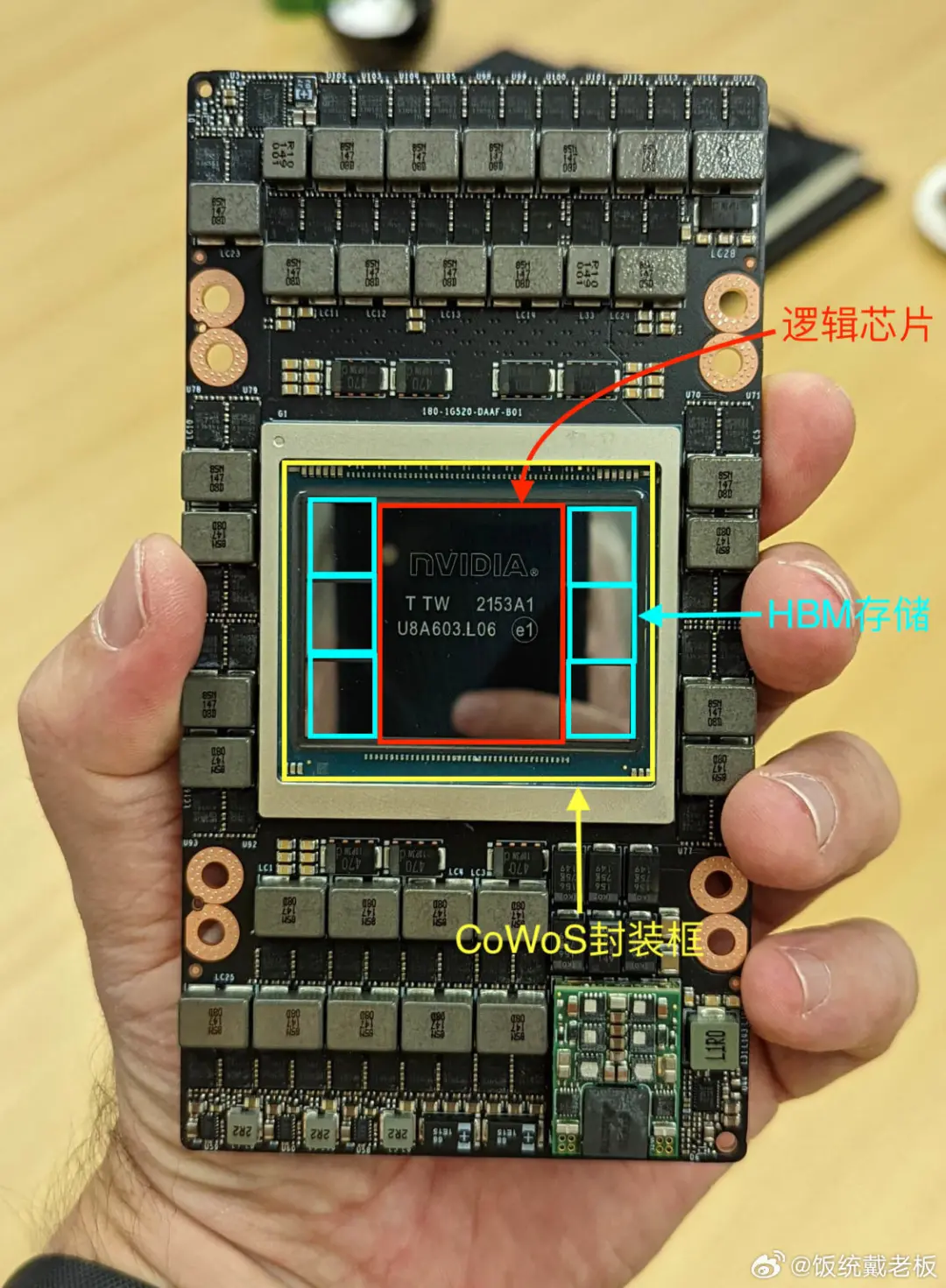

如圖所示,H100最通用的版本H100 SXM採用的是台積電CoWoS的7晶粒封裝,6顆16G的HBM3晶片分列兩排緊緊圍繞着中間的邏輯晶片。

而這也構成了H100最重要的三個部分:邏輯晶片、HBM存儲晶片、CoWoS封裝,除此之外,還有諸如PCB板以及其他的一些輔助器件,但價值量不高。

H100拆機圖

核心的邏輯晶片尺寸是814mm^2,產自台積電最先進的台南18號工廠,使用的工藝節點則是「4N」,雖然名字上是4打頭,但實際上是5nm+。由於5nm的下游,手機等領域的景氣度不佳,因此台積電在保供邏輯晶片上沒有任何問題。

而這塊邏輯晶片是由12寸(面積70,695mm^2)的晶圓切割產生,理想狀態下可以切出86塊,但考慮到「4N」線80%的良率以及切割損耗,最後一張12寸晶圓只能切出65塊的核心邏輯晶片。

這一塊核心邏輯晶片的成本是多少呢?台積電2023年一片12寸的晶圓對外報價是13,400美元,所以折算下來單塊大概在200美元左右。

接下來是6顆HBM3晶片,目前由SK海力士獨供,這家起源於現代電子的企業,2002年幾乎要委身與美光,憑藉着政府的輸血以及逆周期上產能的戰略,如今在HBM的量產技術上至少領先美光3年(美光卡在HBM2e,海力士2020年中期量產)。

HBM的具體價格,各家都諱莫如深,但根據韓媒的說法,HBM目前是現有DRAM產品的5-6倍。

而現有的GDDR6 VRAM的價格大概是每GB3美元,如此推算HBM的價格是在每GB 15美元左右。

那一張H100 SXM在HBM上的花費就是1500美元。

雖然今年HBM的價格不斷上漲,英偉達、Meta的高管也親赴海力士「督工」,可下半年三星的HBM3就能逐步量產出貨,再加上韓國雙雄祖傳的擴張血脈,想必到了明年HBM就不再是瓶頸。

而真正是瓶頸的則是台積電的CoWoS封裝,這是一種2.5D的封裝工藝。

相比於直接在晶片上打孔(TSV)、布線(RDL)的3D封裝,CoWoS可以提供更好的成本、散熱以及吞吐帶寬,前兩者對應HBM,後兩者則是GPU的關鍵。

所以想要高存力、高算力的晶片,CoWoS就是封裝上的唯一解。英偉達、AMD兩家的四款GPU都用上了CoWoS就是最好的佐證。

CoWoS的成本是多少呢?台積電22年財報披露了CoWoS工藝佔總營收7%,於是海外分析師Robert Castellano根據產能,以及裸晶的尺寸推算出封裝一塊AI晶片能給台積電帶來723美元的營收。

因此把上述最大的三塊成本項加總,合計在2,500美元左右,其中台積電佔了$1,000(邏輯晶片+CoWoS)左右,SK海力士佔了1500美金(未來三星肯定會染指),再算上PCB等其他材料,

整體物料成本不超過3000美金。

那H100賣多少錢呢?35000美金,直接加了一個零,毛利率超過90%。

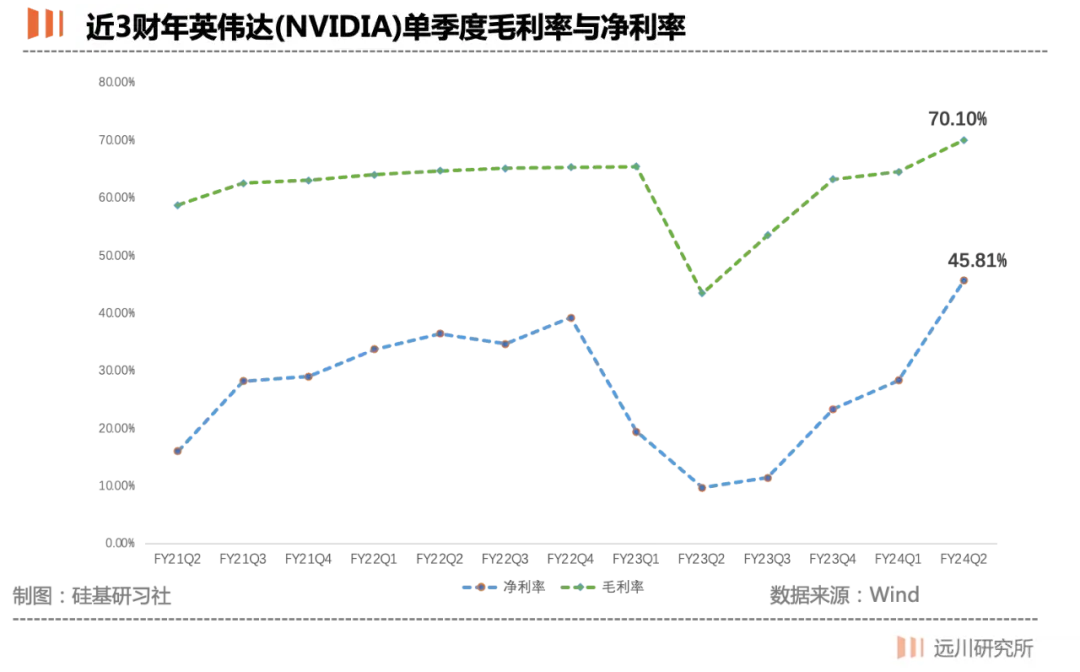

過去10年英偉達毛利率大概在60%上下,現在受高毛利的A100/A800/H100的拉動,今年Q2英偉達的毛利率已經站上了70%。

這有點反常識:英偉達嚴重依賴台積電的代工,後者地位無人撼動,甚至是唯一能卡英偉達脖子的核心環節。但這麼一塊3.5萬美金的卡,製造它的台積電只能拿1000美金,而且只是收入,不是利潤。

不過,用毛利率來定義暴利,對於晶片公司意義不大,要是從沙子開始算,那毛利率更高。一張4N工藝的12寸晶圓,台積電賣給誰都差不多是1.5萬美金一片,英偉達能加個零賣給客戶,自然有其訣竅。

這個訣竅的秘密在於:英偉達本質上,是一個偽裝成硬件廠商的軟件公司。

軟硬一體的護城河

英偉達最強大的武器,就藏在毛利率減去淨利率的那一部分。

在本輪AI熱潮之前,英偉達的毛利率常年維持在65%上下,而淨利率通常只有30%。而今年Q2受高毛利的A100/A800/H100的拉動,毛利率站上70%,淨利率更是高達45.81%。

近 3 財年英偉達(NVIDIA)單季度毛利率與淨利率

英偉達目前在全球有超過2萬名員工,大都是高薪的軟硬件工程師,而根據美國獵聘Glassdoor的數據,這些崗位的平均年薪基本都高於20萬美元/年。

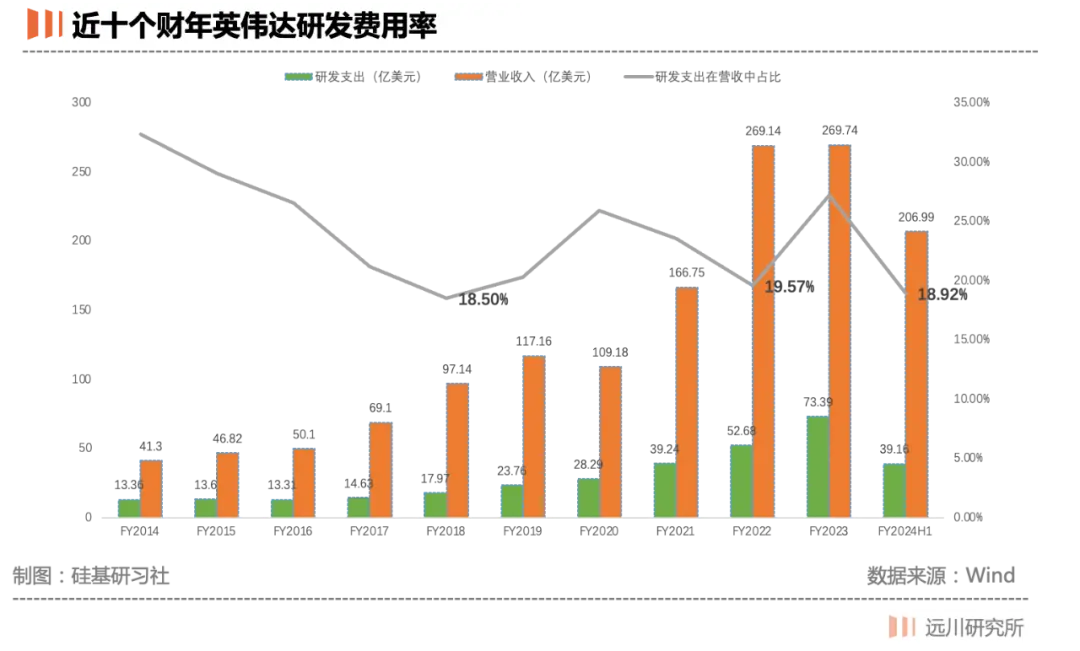

近十個財年英偉達研發費用率

在過去的十年裏,英偉達研發支出的絕對值保持着高速增長,而研發費用率穩態下也維持在20%以上。當然,如果某一年的終端需求爆發,比如2017年的深度學習、21年的挖礦、以及今年的大語言模型,營收的分母驟然抬升,研發費用率就會短暫的跌倒20%,相應地利潤也會非線性暴增。

而在英偉達研發的這麼多項目中最關鍵的無疑是CUDA。

03年為解決DirectX編程門檻過高的問題,Ian Buck的團隊推出了一款名為Brook的編程模型,這也是後來人們常說的CUDA的雛形。06年Buck加入英偉達,並說服黃仁勛研發CUDA。

因為支持C語言環境下的並行計算,使得CUDA一躍成為工程師的首選,也讓GPU走上了通用處理器(GPGPU)的道路。

在CUDA逐漸成熟之後,Buck再次勸說黃仁勛,讓英偉達未來所有的GPU都必須支持CUDA。06年CUDA立項,07年推出產品,當時英偉達的年營收僅有30億美元,卻在CUDA上花費5億美金,到了17年時,單在CUDA上的研發支出就已超過了百億。

曾經有位私有雲公司的CEO在接受採訪時說過,他們也不是沒想過轉去買AMD的卡,但要把這些卡調試到正常運轉至少需要兩個月的時間。

而為了縮短這兩個月,英偉達投入上百億走了20年。

晶片行業浮沉大半個世紀,從來沒有一家企業像英偉達一樣,既賣硬件、也賣生態,或者按黃仁勛的話來說:「賣的是准系統」。

因此,英偉達對標的也的確不是晶片領域的那些先賢們,而是蘋果——另一家賣系統的公司。

從07年推出CUDA,到成為全球最大的印鈔廠,英偉達也並不是沒有過對手。

08年當時晶片屆王者英特爾中斷了與英偉達在集顯項目上的合作,推出自己的通用處理器(GPCPU),打算在PC 領域「劃江而治」。可英偉達在隨後幾年的產品疊代中,硬是把自家處理器推廣到太空、金融、生物醫療等需要更強大計算能力的領域,於是10年英特爾眼看打壓無望,被迫取消了獨立顯卡計劃。

09年蘋果的開發團隊推出了OpenCL,希望能憑藉着通用性在CUDA身上分一杯羹。但OpenCL在深度學習的生態上遠不如CUDA,許多學習框架要麼是在CUDA發佈之後,才會去支持OpenCL,要麼壓根不支持OpenCL。於是在深度學習上的掉隊,使得OpenCL始終無法觸及更高附加值的業務。

15年AlphaGo開始在圍棋領域初露鋒芒,宣告人工智能的時代已經來臨。此時的英特爾為了趕上這最後一班車,把AMD的GPU裝入自己的系統晶片內。這可是兩家公司自上世紀80年代以來的首次合作。可如今CPU老大、老二+GPU老二的市值之和僅是GPU老大英偉達的1/4。

從目前看來,英偉達的護城河幾乎是牢不可摧。即使有不少大客戶笑裏藏刀,私下裏在研發自己的GPU,但憑藉着龐大的生態和快速的疊代,這些大客戶也無法撬動帝國的裂縫,特斯拉就是明證。英偉達的印鈔機生意,在可見的未來還會持續。

可能唯一讓黃仁勛縈繞烏雲的地方,便是那個客戶眾多、需求旺盛但H100賣不進去、但人家又在咬牙攻堅的地方——這個地方全世界只有一個。